Questo è solo uno dei casi di fallimento del metodo della peer-review, o “revisione tra pari” (sul blog Retraction watch è possibile trovare una raccolta degli studi ritrattati negli anni).

Cos’ha di diverso invece l’indagine appena pubblicata da Science?

Innanzitutto non si tratta di un solo caso: l’articolo presenta uno studio sistematico fatto su 304 riviste che dichiaravano di utilizzare la peer-review. L’autore ha creato un falso studio con parecchi errori di metodo e di analisi dati e ha inviato un articolo a 304 riviste open access che dichiaravano sul loro sito di garantire un servizio di peer-review. Il risultato? 157 delle riviste in questione hanno pubblicato il falso ed erroneo studio senza battere ciglio. Oltre a mostrare come in molti casi la revisione non venga proprio fatta, Bohannon ha tracciato anche i pagamenti richiesti dalle riviste per pubblicare l’articolo: la maggior parte delle volte la banca al quale arriva si trova in India o in uno stato africano, nonostante la sede della rivista dichiari ad esempio di essere negli Stati Uniti. Infine i revisori molte volte sono non rintracciabili oppure quelli elencati sul sito non hanno nemmeno mai accettato di esserlo.

Tra le riviste open access in questione molte appartengono a grandi gruppi editoriali come Elsevier e Sage, e fra quelle analizzate da Science vi è anche Plos Biology, una delle riviste open access più note. E a quanto pare anche la più meritevole: Plos Biology infatti è stata l’unica ad aver evidenziato i palesi errori del falso studio e ad averlo rifiutato in due settimane.

E’ quindi la revisione tra pari un sistema da buttare? E se si, a quale nuovo metodo dovrebbe affidarsi la scienza per la sua autovalutazione? A questa domanda ha tentato di rispondere proprio Plos Biology che ha pubblicato qualche giorno fa uno studio statistico su 6527 pubblicazioni, mettendo a confronto tre dei metodi di valutazione della ricerca più utilizzati: la peer-review post pubblicazione, l’impact factor e il numero di citazioni. La risposta? Per ora pare che la scienza dovrà accontentarsi del meno peggio ovvero secondo Adam Eyre-Walker e Nina Stoletzki, autori dello studio, l’impact factor. Sono arrivati ad alcune interessanti conclusioni per i tre metodi considerati, conclusioni che hanno un fattore in comune: l’uomo.

Per esempio, per testare la validità della revisione post pubblicazione ( come avviene per esempio per alcune riviste open access, come la Faculty of 1000) i due autori hanno analizzato il giudizio dato ad ogni paper da ogni singolo revisore: se gli scienziati fossero in grado di dare un giudizio completamente oggettivo su quali sono gli studi meritevoli le valutazioni dovrebbero più o meno coincidere. L’analisi dei dati ha invece mostrato che i voti dei revisori coincidono circa per la metà dei casi; considerando però che si era stimato che solo per casualità sarebbero dovuti coincidere il 40% delle volte, rimane solamente un 7% di casi in cui i revisori si sono trovati d’accordo sulla qualità di una pubblicazione. Essendo l’impact factor della rivista dove è pubblicato lo studio noto ai revisori i due autori hanno deciso di investigare come e se l’IF abbia un ruolo nell’influenzare il giudizio: la risposta è naturalmente si, e si tratta di un ruolo significativo. I revisori mediamente danno un giudizio più positivo agli studi pubblicati su riviste con alto impact factor,come è possibile vedere dal grafico qui sotto, che mostra per l’appunto la proporzione di articoli (appartenenti a uno dei due dataset) valutati in ogni categoria (raccomandato, da leggere, eccezionale) in base all’IF della rivista di pubblicazione:

Le stesse conclusioni valgono per il rapporto tra il voto del revisore e il numero di citazioni che la pubblicazioni ha guadagnato negli anni; anche se è necessario considerare che per definizione gli articoli pubblicati su riviste con alto impact factor sono maggiormente citati e che, in ogni caso, l’accumulo di citazioni è un fenomeno stocastico ( due articoli identici pubblicati su due riviste diverse non avranno lo stesso numero di citazioni).

Per quanto riguarda l’impact factor stesso i dubbi non mancano: essendo un calcolo complessivo non è indicativo del valore del singolo articolo; è influenzato dal tipo di studio fatto, dall’essere scritto o meno in lingua inglese e non è standardizzato tra tutti i campi della scienza.

Ma, secondo i due autori dello studio di Plos Biology, forse il più grande impedimento a utilizzare l’impact factor come metodo di valutazione è proprio il modo in cui noi reagiamo ad esso.

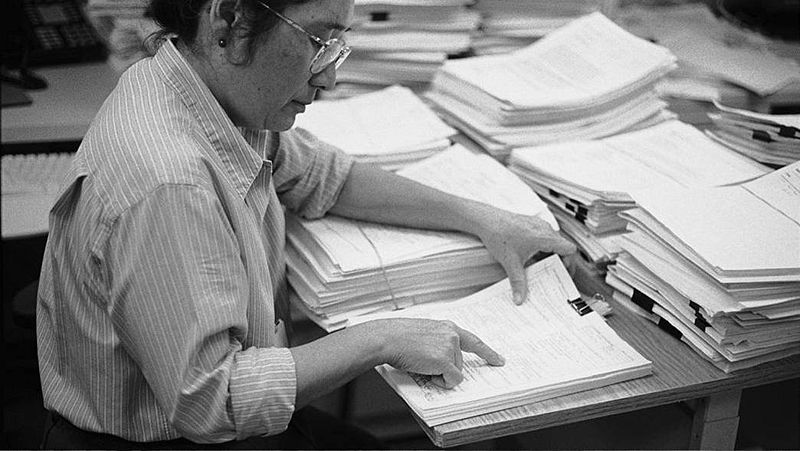

Crediti immagine: Center for Scientific Review, Wikimedia Commons; Plos Biology