Al MIT i computer imparano il linguaggio giocando a un popolare videogioco manageriale

Al MIT i computer imparano il linguaggio giocando a un popolare videogioco manageriale

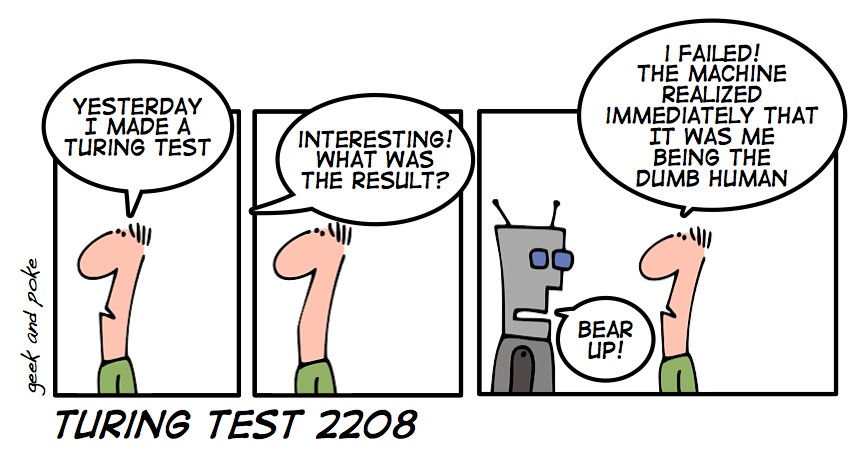

Anche se un po’ datato il Test di Turing è ancora un caposaldo (quasi un monito) nel campo dell’Intelligenza Artificiale: avremo una macchina davvero pensante quando questa sarà in grado di parlare con noi, cioè quando costruiremo un complesso hardware-software capace di padroneggiare il linguaggio simbolico. Pochi mesi fa ha fatto notizia a questo proposito l’impresa di Watson, il supercomputer della IBM che a Jeopardy! (un gioco televisivo popolare in USA) ha battuto due campioni in carne e ossa: non si può ancora affermare che la macchina comprendesse le domande nel modo in cui le intendiamo noi, non più di quanto un chatterbot possa capire quello che gli chiediamo, per quanto, in entrambi i casi, la risposta ci possa soddisfare o meno. Watson ha però dimostrato che, sia per gli uomini che per le macchine, per estrarre informazione non c’è niente di meglio del linguaggio.

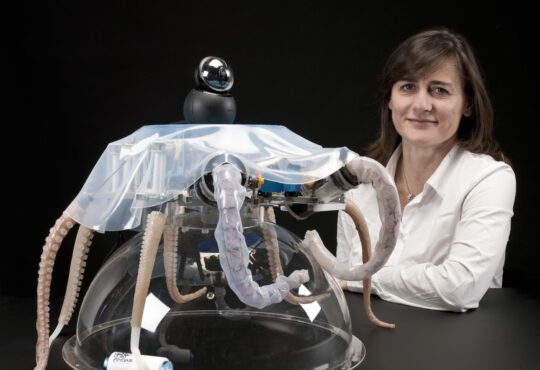

Ne è una prova il sistema messo a punto da Regina Barzilay e S.R.K. Branavan (MIT Computer Science and Artificial Intelligence Laboratory) assieme a David Silver (UCL Department of Cumputer Science). I ricercatori (che hanno presentato il lavoro al meeting della Association for Computational Lingustic) hanno usato come banco di prova (come spesso accade in questo campo) un videogioco, il popolarissimo Civilization. È già noto che con determinati algoritmi, procedendo per tentativi ed errori, una macchina è in grado di apprendere da sola i passaggi necessari a risolvere un problema, ma in questo caso i ricercatori hanno permesso al programma, giocando, di sbirciare il manuale. Civilization, come ogni videogioco, informa il giocatore con messaggi sullo schermo in risposta a determinate azioni. Il sistema di apprendimento automatico utilizzato è stato potenziato dandogli sufficienti basi linguistiche per confrontare queste parole con quelle del manuale di gioco.

Risultato: senza istruzioni il manuale di gioco vinceva il 46 % delle volte, con il manuale ben il 79%.

La cosa fenomenale (forse anche da un punto di vista che trascende l’ambito informatico) è che il computer, così come in partenza non aveva alcuna informazione sullo scopo del gioco (della serie, l’importante è vincere) non aveva alcuna base nemmeno in merito alla lingua del manuale. A parità di condizioni, anche con un’ipotetica versione in swahili del videogioco (e ovviamente del manuale) si otterrebbero gli stessi risultati. Come un bambino che impara la lingua usata intorno a lui, così il computer, confrontando le informazioni a schermo riferite agli oggetti e alle azioni del gioco con le istruzioni di gioco del manuale, impara (in mancanza di una terminologia più appropriata) sia a giocare sia a giocare meglio man mano che aumentano le sue capacità “linguistiche”.

Ancora una volta sembra farsi largo l’ipotesi che il test di Turing diventerà obsoleto in un futuro non troppo lontano, probabilmente ben prima di quanto suggerito dalla vignetta.