La scuola delle macchine pensanti

Ovvero, come infondere nelle macchine un barlume di consapevolezza (e, talvolta, stupirsi dei risultati)

TECNOLOGIA – Quante scuole ci saranno nel mondo? Difficile rispondere, di sicuro un numero molto alto. Altra domanda difficile: in ogni scuola, a quanti test saranno sottoposti ogni anno gli studenti per verificarne il grado di preparazione? Probabilmente un numero davvero considerevole.

Proviamo adesso con un altro quesito: quante scuole in tutto il mondo hanno come “studenti” i robot? E in quante di esse i robot stessi sono sottoposti a test volti a capire se stanno manifestando sensibilità, consapevolezza, creatività?

La risposta stavolta è più semplice: esiste almeno un posto al mondo in cui tutto ciò accade. Si tratta del Rensselaer AI and Reasoning Lab di New York, diretto dal professor Selmer Bringsjord. Sì, avete letto bene: è proprio un laboratorio in cui le macchine vengono addestrate a ragionare. Di recente, in particolare, i ricercatori di quel laboratorio hanno condotto un esperimento molto singolare, consistente nel somministrare a tre studenti una “pillola del silenzio”, ossia un farmaco in grado di rendere afono chi lo ingerisce.

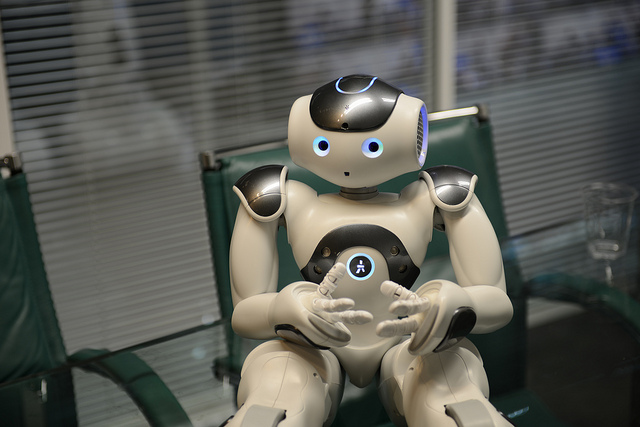

A due dei tre è stata somministrata la pillola, mentre il terzo ha “ingerito” un placebo. Ovviamente, a nessuno dei tre è stato rivelato chi avesse assunto il placebo. Infine, a tutti e tre è stato chiesto di rispondere alla seguente domanda:”Chi di voi tre non ha ingerito la pillola del silenzio?”. Fin qui sembra tutto molto semplice, a patto di non conoscere un dettaglio piuttosto importante: i tre studenti in questione erano in realtà dei Nao Robots, ossia piccole unità robotiche, munite di sofisticati algoritmi di intelligenza artificiale, ideati dagli stessi scienziati del Rensselaer Lab.

L’effetto della pillola del silenzio veniva simulato premendo un tasto sul petto di due dei tre Nao, che di fatto inibiva la loro capacità di emettere suoni. Il terzo Nao, invece, veniva a sua insaputa (ossia, “tagliando” virtualmente i contatti del pulsante con la sua unità di elaborazione centrale) lasciato libero di sintetizzare e generare segnali vocali. Il test ha avuto un esito davvero sorprendente.

Alla domanda dello scienziato:”Chi di voi tre non ha assunto la pillola?”, infatti, l’unico Nao in grado di rispondere ha esclamato:”Non lo so”. Gli altri due sono rimasti, ovviamente, nel più completo silenzio. A quel punto il Nao in grado di “parlare”, dopo qualche istante di “riflessione” (o, per meglio dire, elaborazione) ha pronunciato la seguente frase: “Chiedo scusa, ora lo so. Sono in grado di provare che io non ho assunto nessuna pillola del silenzio”.

Si tratta di un risultato che lascia stupiti, perché, come appare chiaro, il Nao sembra aver dimostrato, con questa risposta, di possedere un barlume di coscienza o, per meglio dire, di autoconsapevolezza. In effetti, che cosa rende davvero noi umani diversi da qualunque macchina, seppure sofisticatissima, se non la nostra capacità di essere consapevoli di noi stessi come entità separate dal resto del mondo, in grado pertanto di percepire noi stessi nel nostro relazionarci con gli altri come dei ben distinti “Io”?

E, in effetti, questo test mostra che il robot è in grado di capire una domanda e dimostrare allo stesso tempo capacità di ragionamento e riconoscimento della sua stessa “voce”. Una domanda sorgerà spontanea: in che modo è stato possibile raggiungere un simile risultato? Si potrebbe cercare una (parziale) risposta scorrendo la lista delle pubblicazioni e dei progetti di ricerca in corso nel laboratorio diretto dal professor Bringsjord. Una dei concetti-chiave di tali ambiziosi programmi è la formalizzazione algoritmica della cosiddetta Logica Deontica.

Essa può essere considerata come lo studio dei comportamenti umani (o artificiali) in presenza di situazioni di obbligo, divieto, diritto e facoltà di eseguire una certa azione. In altri termini, i ricercatori del Rensselaer Lab hanno “infuso” nei Nao Robots la capacità di analizzare il proprio comportamento in presenza di vincoli sostanziali, come, ad esempio, la capacità o l’impossibilità di “parlare”. Inoltre, grazie a tali algoritmi, il robot è divenuto capace di relazionare tale facoltà o impossibilità ad altri robot o a sé stesso, e su sé stesso formulare in tal modo un giudizio.

Un altro esperimento descritto negli articoli di Bringsjord riguarda il tranello della cosiddetta “falsa convinzione”: a un automa, chiamato Bob, viene chiesto di posizionare un oggetto in un certo cassetto di una cucina. Poi Bob viene fatto allontanare, e l’oggetto viene spostato a sua insaputa in un altro cassetto. Tutto avviene sotto lo “sguardo” di un secondo automa, di nome Alice. L’esperimento consiste nel chiedere ad Alice di prevedere dove Bob andrà a cercare l’oggetto al suo ritorno.

Come si può notare, esistono in questo esperimento almeno due livelli di “percezione” di Alice: la prima sulla reale posizione dell’oggetto, e la seconda sulla sua idea della percezione della stessa posizione nella “mente” di Bob. Secondo Bringsjord, è proprio analizzando questi scenari che si perverrà ad una conoscenza più compiuta del concetto di coscienza, ed ad un progresso sempre più rapido nella creazione di macchine intelligenti.

Se vi sembra che i traguardi finora raggiunti siano trascurabili, o scontati, provate a contare le volte in cui un animale dalle capacità sofisticate, come il gatto, torna indietro per trasportare i suoi cuccioli quando si sposta, afferrandoli tra le fauci uno per volta. Scoprirete probabilmente che la premurosa mamma felina torna indietro almeno una volta in più del numero effettivo dei cuccioli. Questo perché, a differenza di quanto con ogni probabilità i robot di Bringsjord hanno già appreso a fare, mamma gatta non sa contare.

Leggi anche: Coraggio, dica 100001

Pubblicato con licenza Creative Commons Attribuzione-Non opere derivate 2.5 Italia. ![]()

Crediti immagine: Stephen Chin, Flickr