Risolvere il “problema del maschio bianco” in informatica

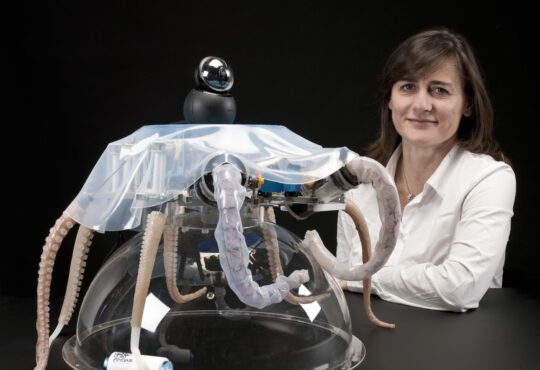

L’intelligenza artificiale può imparare tutto, anche i pregiudizi. Così gli algoritmi, messi a punto da uomini e allenati su dati che riflettono una società non equa, sono diventati sessisti. Ma si può rimediare, attraverso un lavoro sulle tecnologie e su di noi.

BERT, il potentissimo software integrato nei motori di ricerca di Google, preferisce utilizzare pronomi maschili anche quando parla di una donna. Amazon nel 2018 ha dovuto ritirare un sistema di valutazione dei candidati perché penalizzava le candidate di genere femminile. E solo qualche anno fa Siri, l’assistente vocale dei sistemi Apple, era in grado di proporre prestazioni di escort femminili e fornitori di Viagra, ma non conosceva il significato della parola “stupro”. Di storie e aneddoti simili ce ne sono tanti, come raccontano anche Emanuela Griglié e Guido Romeo nel libro “Per soli uomini” (Codice Edizioni, 2021).

Chi studia la questione parla di problema del maschio bianco, che si può riassumere così: praticamente tutti gli sviluppatori e tecnologi appartengono allo stesso genere, vivono nello stesso contesto e hanno alle spalle esperienze molto simili, così tendono a trascurare il punto di vista e le esigenze di chi è al di fuori della loro bolla.

Ad alimentare il bias di genere (ma anche quello relativo all’etnia) contribuiscono poi i dati sui quali gli algoritmi di intelligenza apprendono. In altre parole: se la serie storica delle assunzioni per un posto da chirurgo vede un lungo susseguirsi di nomi maschili, l’algoritmo che apprende da quei dati preferirà sempre un uomo.

Una questione di allenamento

Non si tratta di dilemmi da convegni accademici, ma di un problema concreto. Ci si affida sempre di più alla tecnologia, in particolare all’AI: per assumere in azienda, per scremare le candidature in un college prestigioso, per giudicare un imputato in un’aula di tribunale. Eppure questi cervelli elettronici non sempre se la cavano così bene. È dimostrato che gli assistenti vocali capiscono meglio se parla un uomo, così come i sistemi di riconoscimento facciale sono più efficienti di fronte a tratti maschili.

Se su Google Immagini cercate i termini “shopping” o “lavoro”: davanti ai vostri occhi si presenteranno molte donne (nel primo caso) o molti uomini (nel secondo). Questo perché l’algoritmo, passando in rassegna miliardi di immagini, ha fatto propri i pregiudizi umani e i ruoli imposti dalla società.

“Risolvere i bias legati ai dati di allenamento rappresenta una sfida importante e quanti mai attuale”, ci spiega Fosca Giannotti, dirigente di ricerca presso ISTI-CNR ed esperta di intelligenza artificiale. “Lo hanno capito anche i decisori politici, che stanno iniziando a investire molto nella ricerca in questo senso”.

Per migliorare l’etica delle macchine, gli scienziati lavorano soprattutto sulla validazione dei dati di allenamento, sviluppando metodi automatici in grado di passare al setaccio tutte le informazioni di un database e segnalare eventuali sbilanciamenti statistici. “Bisogna stare molto attenti, perché a volte i bias possono essere anche indiretti. Per esempio può capitare che, in mezzo a centinaia di curriculum in cui il genere non è specificato, un algoritmo discrimini comunque le donne, perchè magari sono così in minoranza in quei dati che l’algoritmo tenderà a trascurarle”, racconta Giannotti.

Hey, bro!

La giornalista di Bloomberg Emily Chang, in un’inchiesta sulla cultura maschilista nel mondo delle Big Tech, scrive: “La Silicon Valley è un’utopia moderna in cui chiunque può cambiare il mondo. A meno che tu non sia una donna”. Chang ha coniato il termine Brotopia, che rende bene l’idea del clima che si respira nei corridoi dei colossi californiani. Qui le donne sono una netta minoranza in tutti i livelli di carriera. “Quando si parla di Intelligenza Artificiale e della trasformazione che porterà alla società i, il problema a mio avviso più importante riguarda la scarsa presenza femminile tra chi progetta le tecnologie quindi non c’è il contributo delle ragazze nella progettazione del futuro”, prosegue Giannotti.

In effetti, i dati delle iscritte a corsi di laurea come ingegneria informatica o informatica al momento non sono confortanti, si parla di meno di 1 studentessa ogni 10 studenti maschi. “Negli ultimi anni si è assistito a un peggioramento. Quando ho iniziato il mio percorso universitario il rapporto non era così sbilanciato, anzi: Scienze dell’Informazione [così si chiamava il primo corso di laurea in informatica, ndr] aveva il sapore della cosa nuova, del futuro. Poi a un certo punto si è radicata la convinzione che scrivere codice fosse roba da nerd”, ricorda Giannotti.

Tutto questo ha una ricaduta diretta sulle tecnologie, che, spesso anche inconsapevolmente, riflettono i ruoli sociali, i gusti e le attitudini di chi le ha messe a punto. Come se ne esce?

Rompere il soffitto di silicio

Secondo Giannotti, si deve agire su due fronti. Il primo riguarda le nuove generazioni, dove è necessario fare un lavoro di tipo culturale, magari in collaborazione con le scuole dell’infanzia. “Ci sono dei punti da non dare per scontati ed è da lì che si deve iniziare: la tecnologia non è una cosa da maschi e le femmine non sono meno portate per le materie scientifiche”, riflette la scienziata.

E poi servono misure tanto urgenti quanto necessarie. “Serve seguire con determinazione l’obiettivo di bilanciamento di genere anche nelle discipline scientifiche. Questo obiettivo va perseguito in tutti i settori perché la diversità è ricchezza. Sono favorevole alle quote rosa, perché i sistemi sociali tendono ad auto-mantenersi finché qualcuno non introduce un nuovo elemento, un punto di rottura. Quindi ben vengano in questo momento storico le discriminazione in positivo per tutti i gruppi fragili e le minoranze, in attesa che non ce ne sia più bisogno”.

Per la scienziata, a guadagnarci sarebbero tutti. “Inserire più donne tra le fila dei programmatori può portare un punto di vista diverso e quindi una reale ricchezza”.

Leggi anche: Evelyn Berezin, l’inventrice del primo word processor

Articolo pubblicato con licenza Creative Commons Attribuzione-Non opere derivate 2.5 Italia.

Immagine: Photo by Kelly Sikkema on Unsplash